01 멘토 소개

김홍인

•

Computer Vision, Event classification, OCR, Vision-Language Pretraining 기술 연구 개발

•

Human Computer Interaction, Object Tracking, Image Processing

은현준

•

Computer Vision, Deep Learning 기반의 Video Understanding, OCR, Vision-Language Pretraining 기술 연구 개발

김지성

•

Computer Vision, Hand Posture Recognition, Face Recognition, Vision-Language Pretraining 기술 연구 개발

02 프로젝트 소개

•

배경

◦

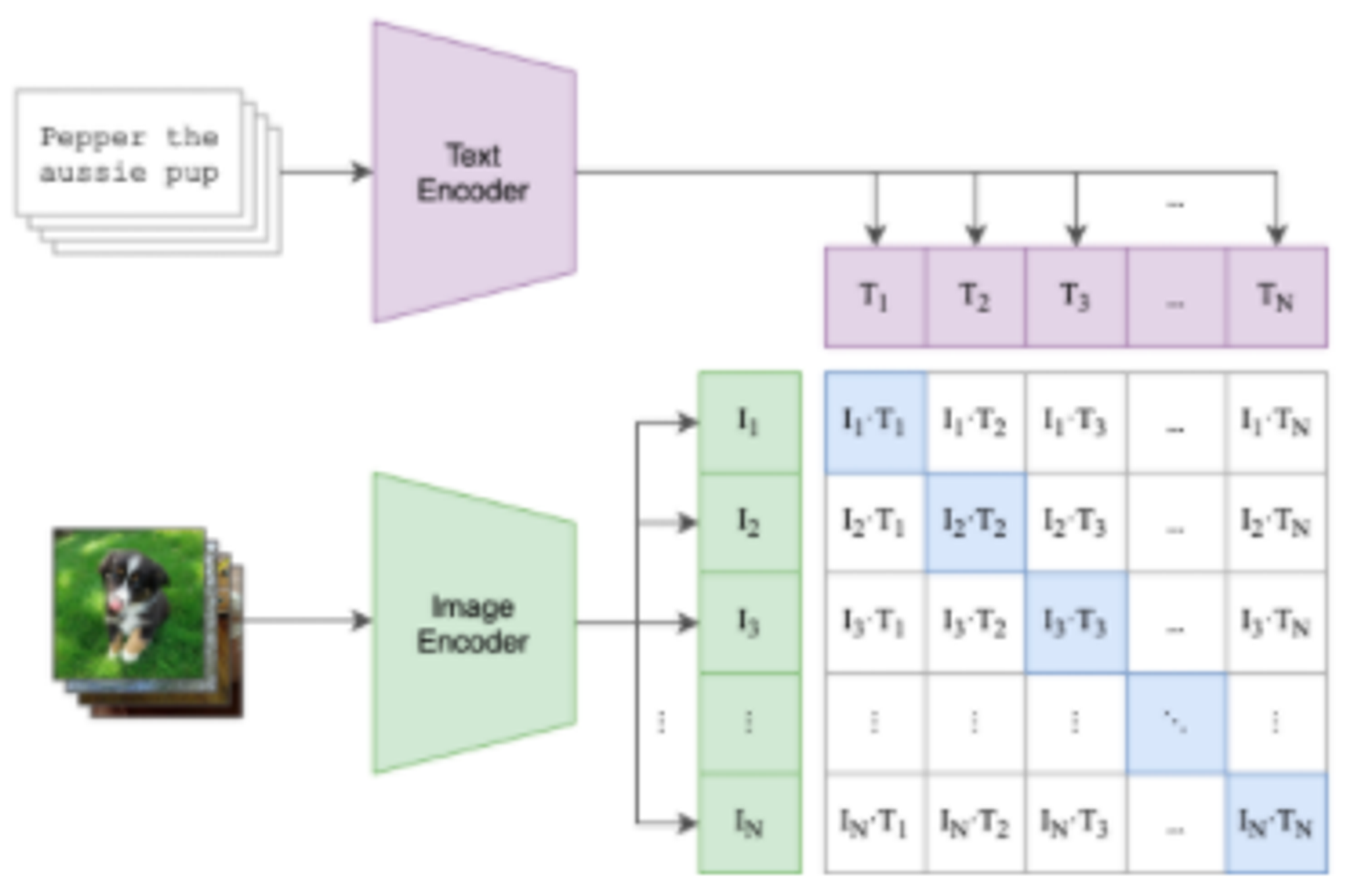

최신 Vision-Language Pretraining 연구가 각광 받고 있으며, 이에 따라 많은 연구 (CLIP, DALLE, SLIP, ALIGN, BLIP, OFA 등)가 소개되고 있음.

<Summary of CLIP>

◦

이러한 사회적 트렌드에 따라 SKT에서도 활발히 Vision-Langugage Pretraining 기술 연구 개발을 진행중.

•

목표

◦

Vision-Language Pretraining Model의 선행 기술 확보 차원의 활용

▪

다양한 최신 연구들의 정리 및 차이점 분석

▪

Vision-Language Pretraining Model 의 개선 방안 논의

◦

Vision-Language Pretraining Model의 응용 분야를 발굴하여 실제 적용 검토

▪

Vision-Language 를 고려하여, 소비자들을 편리하게 혹은 흥미롭게 할 수 있는 응용 분야 발굴

▪

응용 분야에 Vision-Language Pretraining Model 기술의 최적화

03 이런 fellow를 찾습니다

•

딥러닝 기반의 컴퓨터 비전, 자연어 처리 연구 경험

•

최신 Vision-Language Pretraining 연구 및 개발 동향 이해

.jpg&blockId=ac48130f-7433-4b52-b820-90fbf569d447)

.jpg&blockId=8dc66c21-7b28-4080-9a2b-de33b9c4e6a6)